¿Eres más inteligente que las IA?

Si puedes identificar lo que hay en estas imágenes, eres más inteligente que la IA

En los últimos años ha mejorado enormemente la visión artificial, pero aún es capaz de cometer ciertos errores, es así que hay un campo de investigación dedicado al estudio de imágenes identificados erróneamente por la IA, conocidos como "imágenes adversas". Las veremos como ilusiones ópticas para las computadoras, por ejemplo, si tu ves un gato en un árbol, posiblemente la IA vea una ardilla.

Al poner los sistemas de visión artificial en la vida diaria, como cámaras de seguridad AI y autos conducidos por sí solos, se asegura que las computadoras vean el mundo de la misma manera que nosotros lo vemos.

Si bien, en esta área se presta muchísima atención a las imágenes creadas principalmente para engañar a las IA (un ejemplo es esta tortuga impresa en 3D donde los algoritmos de Google la confunden con un arma), este tipo de imágenes algo confusas también ocurren de forma natural, sin intenciones de confundir, vaya.

Un grupo de investigadores de la UC Berkeley, la Universidad de Washington y la Universidad de Chicago, crearon un conjunto de datos de unos 7,500 "ejemplos adversos naturales", donde probaron diversos sistemas de visión artificial en estos datos, y descubrieron que su precisión se reduce hasta en un 90 por ciento, con el software sólo se es capaz de identificar el dos o tres por ciento de las imágenes en algunos casos.

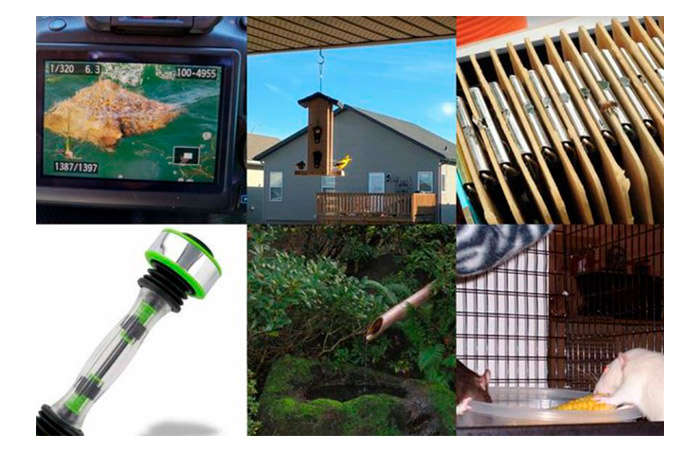

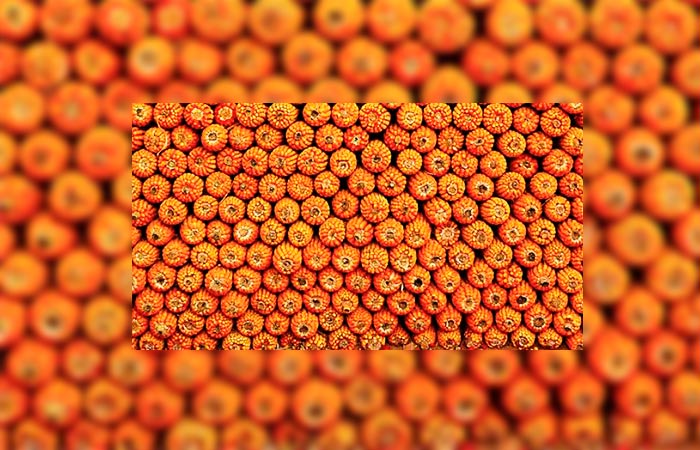

Puedes ver cómo se ven estos "ejemplos adversos naturales" en las siguientes imágenes:

Los investigadores mencionan que los datos presentados ayudarán a formar sistemas de visión más exactos, donde explican las imágenes como "fallas profundas" derivadas de la "excesiva dependencia del software sobre el color, la textura y las señales de fondo" para identificar lo que ve.

Por ejemplo, en las siguientes imágenes la IA confunde las imágenes de la izquierda con un clavo, probablemente debido a los fondos de madera. En las imágenes de la derecha, se centran en el alimentador de colibríes, pero se saltan el hecho de que no hay colibríes reales en la imagen.

También, en las cuatro imágenes de abajo aparecen unas libélulas, la IA se enfoca en los colores y texturas, viendo, de izquierda a derecha, una mofeta, un plátano, un león marino y un guante. En cada caso, puede verse la razón de tal error, pero eso no lo hace menos obvio.

Que los sistemas de IA cometan este tipo de errores no es una novedad. Los investigadores han advertido durante años sobre las debilidades de los sistemas de visión creados mediante el aprendizaje profundo, los cuales son "superficiales" y "frágiles", significa que no entienden el mundo con el mismo enfoque como un humano.

Algunas investigaciones destacan que en lugar de ver las imágenes de forma integral, o sea tomando en cuenta la forma y el contenido en general, los algoritmos se centran en texturas y detalles específicos. Los hallazgos presentados en esta investigación confirman esta interpretación, cuando, por ejemplo, las imágenes que muestran sombras claras en una superficie iluminada se identifican erróneamente como relojes de sol.

Con el paso de los años y el perfeccionamiento de la IA tal vez pueda disminuir los errores naturales existentes hoy en día.

TecnologíaInteligencia ArtificialSociedad

Pymes enfrentan mayor riesgo fiscal por errores en registros y conciliación bancaria

Pymes enfrentan mayor riesgo fiscal por errores en registros y conciliación bancaria EAU abandona OPEP+ y ajusta estrategia petrolera ante tensiones en Ormuz

EAU abandona OPEP+ y ajusta estrategia petrolera ante tensiones en Ormuz Especialistas advierten retrasos en diagnóstico por síntomas ignorados en hombres

Especialistas advierten retrasos en diagnóstico por síntomas ignorados en hombres